Dura lex, sed lex

Amende contre X, gouvernance chinoise, l'IA entre au département de la défense US...

Bienvenue sur la lettre d’information du Centre pour la Sécurité de l’IA. Le CeSIA est un organisme à but non lucratif basé à Paris qui se consacre à la formation, à la recherche, à l’analyse et à la communication sur les enjeux et les risques liés à l’intelligence artificielle.

L’amende de 120 millions d’euros infligée par la Commission européenne à X ne représente guère plus de 0,02% de la fortune de son propriétaire, mais l’ire qu’elle a déclenchée chez le milliardaire prouve la solidité de l’ultime rempart protégeant les frontières numériques du Vieux Continent : l’État de droit. Face à cette timide démonstration de souveraineté, Washington ne s’affirme ni pour ni contre, bien au contraire, exigeant dans sa nouvelle Stratégie de défense nationale que « l’Europe reste européenne […] et abandonne son obsession infructueuse pour l’asphyxie réglementaire ».

La condamnation de X pour tromperie de ses utilisateurs et manque de transparence vis-à-vis des chercheurs, une première au titre du règlement sur les services numériques (DSA), envoie deux signaux contraires aux entreprises technologiques. Le premier est rassurant pour nous mais inquiétant pour elles : nous sommes encore capables de faire respecter nos lois sur notre territoire, dussions-nous en payer le prix fort diplomatiquement et commercialement. Le second est rassurant pour elles mais inquiétant pour nous : deux longues années d’impunité peuvent s’écouler entre l’entrée en vigueur d’un règlement et la première sanction prononcée – aussi tardive qu’indulgente.

Qu’a-t-il fallu pour conclure une enquête qui s’enlisait depuis deux ans ? Une poupée sexuelle aux traits de fillette et la diffamation de la première dame de France semblent avoir produit plus d’effets sur le gendarme européen que quinze années d’empoisonnement du débat public par les machines à amplifier la haine algorithmiques. Une toxicité sur laquelle l’enquête de la Commission s’est d’ailleurs gardée de statuer.

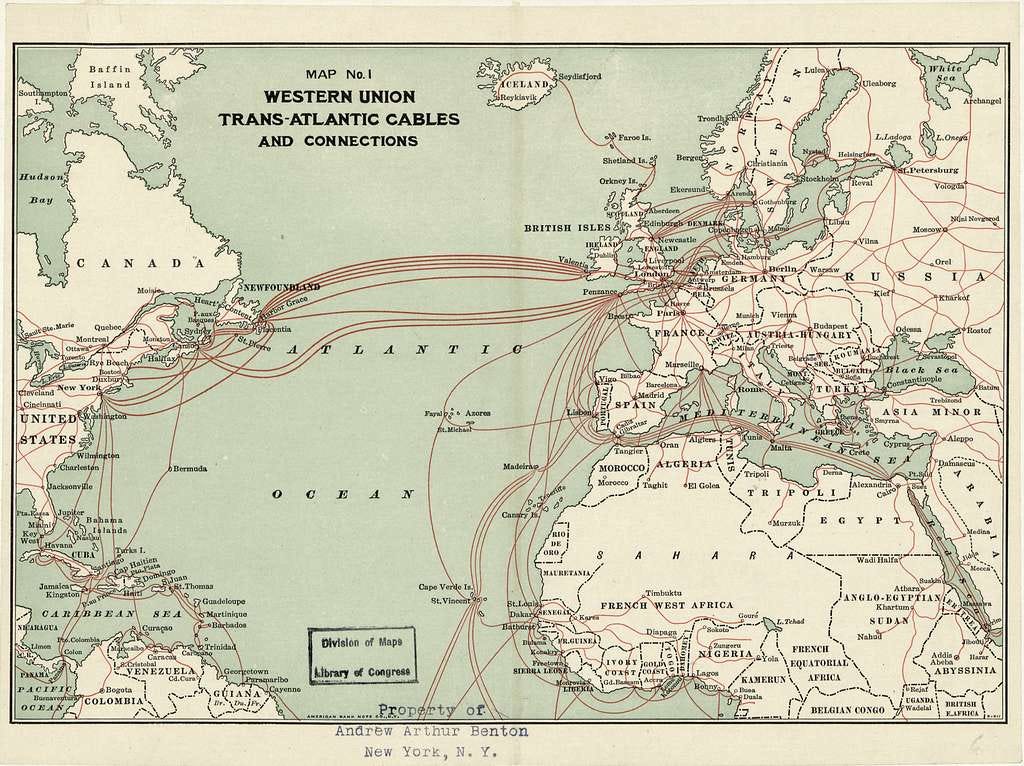

Ces tergiversations, couplées au manque de ressources du Bureau de l’IA et à un AI Act en voie d’être édulcoré avant même d’avoir servi, augurent une certaine langueur de l’exécutif européen face au tsunami algorithmique qui s’apprête à déferler sur la façade atlantique de notre continent. Pour qu’une digue digne de ce nom soit enfin élevée, faut-il attendre que l’IA décide de s’en prendre au poney d’Ursula von der Leyen ?

Nouvelles frontières

Ce dont l’IA était incapable hier

Des experts jugent trompeuse la comparaison entre l’IA et la bulle Internet : « Une différence importante est que les entreprises qui mènent la hausse aujourd’hui sont aussi celles qui gagnent réellement le plus d’argent. » Et de faire remarquer : « Internet n’a pas disparu après l’explosion de la bulle » (The New York Times).

Après avoir analysé 100 000 milliards de tokens générés par les chatbots, OpenRouter estime que les modèles open-source représentent environ un tiers du marché, que la programmation occupe la première place des usages (près de 50 %) et que le roleplay arrive second (environ 20 %) (OpenRouter).

Aux États-Unis, l’agence responsable de l’autorisation de mise sur le marché des médicaments (FDA) a approuvé le premier système d’IA destiné à accélérer le développement de traitements contre les maladies du foie (Reuters).

Pièces à conviction

L’état de l’art en sécurité de l’IA

Jared Kaplan, chief scientist d’Anthropic, avertit que l’humanité devra prendre entre 2027 et 2030 « la décision la plus importante » de l’histoire de l’IA, à savoir autoriser ou non les modèles à entraîner de manière autonome leurs successeurs (The Guardian).

Des études publiées dans Science et Nature montrent que des chatbots peuvent convaincre environ 1 électeur sur 25 de modifier ses préférences électorales (Washington Post).

La nouvelle édition du AI Safety Index révèle que les principales entreprises du secteur sont « très en deçà » des normes de sécurité désirables, la meilleure position du classement étant occupée par Anthropic avec la note C+ (Future of Life Institute).

Géopolitique de l’IA

Coopération vs. compétition

Le Département de la Défense américain déploie le modèle Gemini de Google ; Pete Hegseth, ex-figure de Fox News devenu « ministre de la Guerre », déclare : « l’avenir de la guerre est là, et il s’épelle IA » (Defense News).

La Commission européenne qualifie les récentes attaques d’Elon Musk contre l’UE de « déclarations complètement folles » (Le Monde).

Des sénateurs américains présentent le Safe Chips Act pour empêcher un assouplissement des règles limitant les exportations de puces d’IA vers la Chine (Reuters).

L’UE prévoit d’ouvrir début 2026 un appel d’offres pour des « gigafactories » de calcul destinées à réduire sa dépendance aux infrastructures américaines, même si ces sites continueront de dépendre des GPU Nvidia (01Net).

Cadre légal

Pour que l’IA ne fasse pas la loi

La Chine envisage la création d’un organe international de coordination de la régulation de l’IA, la World Artificial Intelligence Cooperation Organization (WAICO), potentiellement basé à Shanghai (Nature).

Donald Trump veut interdire aux États américains de réguler l’IA afin d’imposer un cadre unique (très allégé) au niveau fédéral (Le Monde).

Au Royaume-Uni, plus de 100 parlementaires ont rejoint l’appel lancé par l’organisation ControlAI en faveur d’une régulation des modèles d’IA les plus puissants (The Guardian).

La vie du CeSIA

Appel aux dons pour soutenir notre action

Publication à l’ONU de l’Appel mondial à établir des lignes rouges pour l’IA, organisation d’une masterclass « IA & journalisme » à l’ENS Ulm avec Reporters sans frontières (RSF), contribution au Code de bonnes pratiques de l’AI Act, échanges au plus haut niveau sur la gouvernance de l’IA : 2025 a été une année extrêmement intense au CeSIA.

Aucune de ces avancées n’aurait été possible sans le soutien de nos donateurs. Vous pouvez contribuer par un don défiscalisé à 66 % à réduire les risques majeurs liés à l’IA.

Le CeSIA à Athens Roundtable

Lors de la 7ᵉ édition du Athens Roundtable on AI and the Rule of Law, organisée à Londres, nous avons exploré les suites concrètes de l’Appel mondial à établir des lignes rouges pour l’IA : perspectives diplomatiques, seuils de risque à définir, premières pistes pour les mécanismes de vérification. Les échanges ont confirmé l’intérêt de la communauté pour une approche coordonnée et ont permis d’identifier les prochaines étapes pour passer du principe à la mise en œuvre.